还记得哈利・波特第一次来到霍格沃茨看到墙上那些既会动又会说话的挂画是多么惊讶吗?如果我们可以将挂画 “复活”,和 500 多年前的蒙娜丽莎来场穿越时空的对话会怎样呢?感谢 AI技术,把画 “复活” 不再是梦!

名画《蒙娜丽莎的微笑》,会动了!

梦娜丽莎转过头,嘴里说着话,微微眨了眨眼,脸上带着温婉的微笑。

是的,《哈利·波特》世界中”会动的画“魔法实现了!来自三星AI中心(Samsung AI Center)和莫斯科斯的Skolkovo 科学技术研究所的一组研究人员,开发了一个能将让JPEG变GIF的AI系统。

《哈利·波特》中守卫格兰芬多学院休息室的胖夫人画像

更牛逼的是,该技术完全无需3D建模,仅需一张图片就能训练出惟妙惟肖的动画。研究人员称这种学习方式为“few-shot learning"。当然,如果有多几张照片——8张或32张——创造出来动图效果就更逼真了。比如:

爱因斯坦给你讲物理:

玛丽莲梦露和你 flirt:

本周,三星AI实验室的研究人员发表了一篇题为 “Few-Shot Adversarial Learning of Realistic Neural Talking Head Models” 的论文,概述了这种技术。该技术基于卷积神经网络,其目标是获得一个输入源图像,模拟目标输出视频中某个人的运动,从而将初始图像转换为人物正在说话的短视频。

论文一发表马上引起轰动,毕竟这项技术创造了巨大的想象空间!

类似这样的项目有很多,所以这个想法并不特别新颖。但在这篇论文中,最有趣的是,该系统不需要大量的训练示例,而且系统只需要看一次图片就可以运行。这就是为什么它让《蒙娜丽莎》活起来。

3个神经网络,让蒙娜丽莎活起来

这项技术采用“元学习”架构,如下图所示:

图2:“让照片动起来”元学习架构

具体来说,涉及三个神经网络:

首先,嵌入式网络映射输入图像中的眼睛、鼻子、嘴巴大小等信息,并将其转换为向量;

其次,生成式网络通过绘制人像的面部地标(face landmarks)来复制人在视频中的面部表情;

第三,鉴别器网络将来自输入图像的嵌入向量粘贴到目标视频的landmark上,使输入图像能够模拟视频中的运动。

最后,计算“真实性得分”。该分数用于检查源图像与目标视频中的姿态的匹配程度。

元学习过程:只需1张输入图像

研究人员使用VoxCeleb2数据集对这个模型进行了预训练,这是一个包含许多名人头像的数据库。在这个过程中,前面描述的过程是一样的,但是这里的源图像和目标图像只是同一视频的不同帧。

因此,这个系统不是让一幅画去模仿视频中的另一个人,而是有一个可以与之比较的ground truth。通过持续训练,直到生成的帧与训练视频中的真实帧十分相似为止。

预训练阶段允许模型在只有很少示例的输入上工作。哪怕只有一张图片可用时,结果也不会太糟,但当有更多图片可用时,结果会更加真实。

实验和结果

研究人员使用2个数据集分别进行定量和定性评估:VoxCeleb1数据集用于与基准模型进行比较,VoxCeleb2用于展示他们所提出方法的效果。

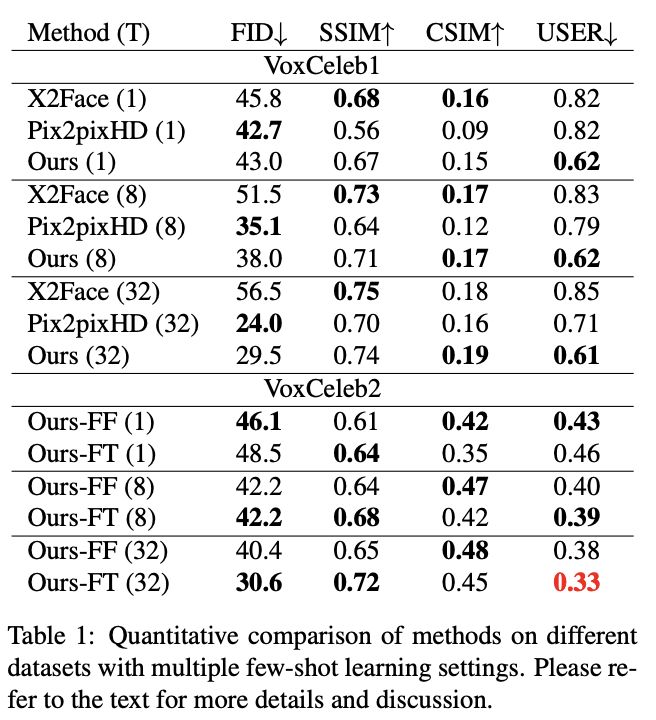

研究人员在三种不同的设置中将他们的模型与基准模型进行了比较,使用fine-tuning集中的1帧、8帧和32帧。

表1:few-shot learning设置下不同方法的定量比较

结果如表1上半部分所示,基线模型在两个相似性度量上始终优于我们的方法。

不过,这些指标不能完全代表人类的感知,因为这两种方法都会产生恐怖谷伪影,从图3的定性比较和用户研究结果可以看出。

另一方面,余弦相似度与视觉质量有更好的相关性,但仍然倾向于模糊、不太真实的图像,这也可以通过表1-Top与图3中的比较结果看出。

图3:使用1张、8张和32张训练图像时的三个示例。系统采用一个源图像(第1列),并尝试将该图像映射到ground truth帧中的相同位置(第2列)。研究人员将他们的结果与X2Face、PixtopixHD模型进行了比较。

大规模的结果。

随后,我们扩展可用的数据,并在更大的VoxCeleb2数据集中训练我们的方法。

下面是2个变体模型的结果:

图4:在VoxCeleb2数据集中的最佳模型的结果。

同样,训练帧的数量是T(左边的数字),第1列是示例训练帧。第2列是ground truth图像,后3列分别是我们的FF feed-forward 模型及微调前后的结果。虽然 feed-forward变体的学习更快速,但fine-tuning 最终提供了更好的真实感和保真度。

最后,我们展示了的照片和绘画的结果。

图5:让静态照片“活”起来